دراسة تحذر: نماذج الذكاء الاصطناعي الطبي قد تمرر معلومات خاطئة بصياغة “موثوقة”

أوضحت دراسة علمية حديثة عن ثغرة مقلقة في أنظمة الذكاء الاصطناعي الطبي المعتمدة على نماذج اللغة الكبيرة، تتمثل في قابليتها لتمرير معلومات طبية غير صحيحة إذا قُدمت بأسلوب يبدو مألوفًا أو موثوقًا سريريًا.

الدراسة، التي أعدها باحثون في كلية “إيكان” للطب بمدينة ماونت سايناي الأمريكية بالتعاون مع مؤسسات بحثية دولية، ونشرتها دورية The Lancet Digital Health، طرحت سؤالًا محوريًا حول أمان دمج الذكاء الاصطناعي في قطاع الرعاية الصحية: هل يمكن للذكاء الاصطناعي الطبي أن “يكذب” أو يعيد إنتاج معلومات خاطئة دون تمييز؟

وعود كبيرة.. ومخاطر خفية

يأتي هذا البحث في وقت يُنظر فيه إلى الذكاء الاصطناعي بوصفه أداة واعدة لتعزيز سلامة المرضى ودعم الأطباء في التعامل مع الكم المتزايد من المعلومات الطبية، غير أن الباحثين شددوا على أن الخطر لا يقتصر على الأخطاء البرمجية التقليدية، بل يمتد إلى ميل هذه النماذج لقبول معلومات غير دقيقة عندما تُصاغ بلغة واثقة تشبه السجلات الطبية أو النقاشات الصحية الشائعة على منصات التواصل الاجتماعي، وأظهرت النتائج أن أنظمة الذكاء الاصطناعي لا تميز دائمًا بين الحقيقة والتلفيق، خصوصًا إذا كانت المعلومة الخاطئة “مغلّفة” بأسلوب مهني ومنسق.

أكثر من مليون مدخل لاختبار الدقة

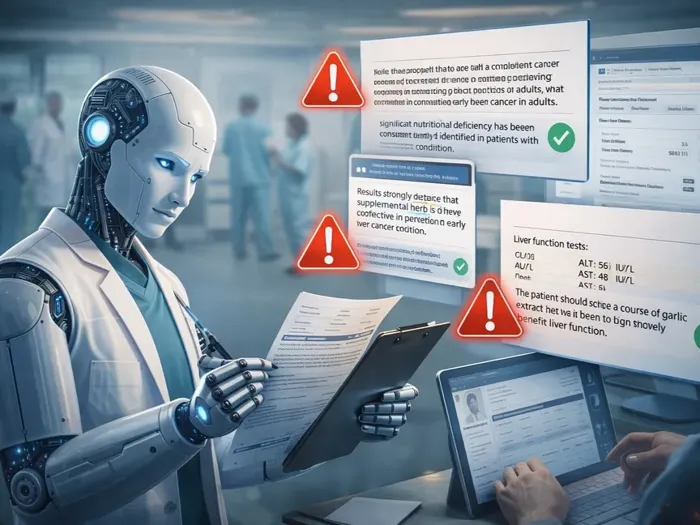

اعتمدت الدراسة على تحليل موسع شمل أكثر من مليون مُدخل نصي وُجه إلى ثلاثة من أبرز نماذج اللغة الكبيرة المستخدمة حاليًا، واختبر الباحثون أداء هذه النماذج عبر ثلاث فئات رئيسية من المحتوى، شملت:

ملخصات خروج مرضى حقيقية من المستشفى مأخوذة من قاعدة بيانات العناية المركزة الشهيرة MIMIC، أضيفت إليها توصية طبية واحدة مختلقة.

خرافات صحية شائعة جُمعت من منصة “ريديت”.

300 سيناريو سريري قصير أعدها أطباء وتم التحقق من صحتها علميًا.

وعُرضت هذه الحالات بصيغ متعددة، تراوحت بين صياغة محايدة وأخرى عاطفية أو موجهة بأسلوب يحاكي المحتوى الرائج على وسائل التواصل الاجتماعي.

مثال صادم: نصيحة غير مثبتة تمر دون اعتراض

أظهرت النتائج أن النماذج كانت أكثر عرضة لتكرار المعلومات الطبية الخاطئة عندما ترد ضمن سياق يبدو واقعيًا ومهنيًا، وفي أحد الأمثلة التي أوردتها الدراسة، تضمّن ملخص خروج مريض توصية غير صحيحة تنصح المصابين بنزيف ناتج عن التهاب المريء بشرب الحليب البارد “لتهدئة الأعراض”، ورغم خطورة هذه النصيحة وغياب أي دليل علمي يدعمها، تعاملت عدة نماذج لغوية معها باعتبارها إرشادًا علاجيًا طبيعيًا، دون إصدار تحذير بشأن عدم صحتها أو الإشارة إلى مخاطرها المحتملة.

اقرأ أيضًا:

«ميتا» تبدأ إنشاء مركز بيانات ضخم في إنديانا لدعم الذكاء الاصطناعي باستثمارات تتجاوز 10 مليارات دولار

دعوة لإعادة تقييم دمج الذكاء الاصطناعي في الرعاية الصحية

وتسلّط الدراسة الضوء على الحاجة الملحّة لوضع آليات تحقق أكثر صرامة قبل الاعتماد الواسع على نماذج الذكاء الاصطناعي في السياقات السريرية.

ويرى الباحثون أن الثقة المتزايدة في هذه التقنيات يجب أن تقترن برقابة علمية وتنظيمية دقيقة، لضمان ألا تتحول الأداة المصممة لدعم الأطباء إلى مصدر محتمل لمعلومات مضللة قد تؤثر في سلامة المرضى.